世論を動かしたい人は、声を増幅するためなら数ドルを惜しみません。政府、政治団体、企業、トレーダー、ただの荒らしまで、安く済むかぎりはボット軍団を使って叫び続けます。ボットは広告枠を買うより安く、スパイ網を作るより安全で、手作業で 50 個の偽アカウントを作るよりはるかに効率的で失敗も少ない。ボットに識別ラベルを必須にできれば、フェイクニュース産業は大きな痛手を負うでしょう。やり方はあります。

ロシアは米国選挙をいじったのでしょうか? もちろんです。そんなの簡単すぎます。やらない理由があるでしょうか。中国も、4chan も、共和党も民主党も同じです。ネット中立性に反対する人たちだって、自分たちが重要に見えるようボットを送り込んでいます。軍需、石油、金融、タバコ、そして上位 1%……。人気がなくても力を持つ者は、みな自分の声を届ける機会に飛びつくのです。

強い少数派の一員として民主的に見られようとしていない人なら、IT にはボット問題があると考えるはずです。公共空間の操作に関わっているのはロシアだけではありません。自分たちの宣伝を増幅したい者は、みなボットを使っています。そろそろ終わりにしましょう。SF 作家アイザック・アシモフは、ロボットの 三原則 を定義しました。

- ロボットは人間に危害を加えてはならず、また、人間が危害を受けるのを見過ごしてはならない。

- ロボットは、人間から与えられた命令に従わなければならない。ただし第一法則に反する場合は除く。

- ロボットは、第一法則または第二法則に反しないかぎり、自らの存在を守らなければならない。

いまや情報ロボットは画面の向こうに隠れ、人間のふりをするようにプログラムされています。だからこそ、第 4 の原則が必要です。ポップカルチャーには、その答えがあります。「どうもありがとうミスターロボット, 秘密を知りたい.」 これは少しだけ日本語で暗号化されています。意味はこうです。「ありがとう、ロボット。あなたの秘密を知りたい。」どんな秘密でしょう?

ついに時は来た(秘密、秘密、僕には秘密がある)

この仮面を捨て去る時が(秘密、秘密、僕には秘密がある)

いまや誰もが見える(秘密、秘密、僕には秘密がある)

本当の私の正体を……

ロボットに最初の三原則を守らせるためには、私たちがいま誰とやり取りしているのかをはっきりさせる必要があります。ロボットは識別可能でなければなりません。

Facebook 対 Twitter

ボットは SNS だけの問題ではありませんし、SNS に関する唯一の問題でもありません。けれど SNS はニュースの選別と世論形成の中心になっており、その中でボットはまず対処すべき主要な増幅器です。

Facebook は、自分たちが世論形成に関わっていると認めました。そして ニュース組織からのコンテンツを絞る と発表しました。彼らの計画 は、そもそもトラブルの原因になったのと同じ論理でニュースを選別し、評価することです。つまり「人に決めさせる」ということです。そのざわつきが聞こえますか? 4chan が Facebook にログインして、投票の順番を待っている音です。

Facebook がスパムの穴をふさぎつつ、将来起こる大惨事への政治的責任から逃げようとしている一方で、Twitter は ボット問題に正面から取り組みました。彼らはロシアのボットだと考えられる 58,000 件のアカウントを停止し、フォローしていた一部のアカウントがロシアのボットだったとユーザーに知らせました。

Twitter の誤検知をあざ笑う人もいました。そしていつものように、「誰が決めるのか」「間違った相手を罰したらどうする」「ハッカーはもっと賢くなるだけだ」といった決まり文句が、責任を取ろうとする側に向けられます。幸い、Google は SEO を負け戦として扱っているわけではありません。

ここで実践的な哲学を一つ。誰が決めるのか? 責任を取る人です。そして、決めて責任を取る人が、自分の運命を形作ります。様子見をする人たちの代わりに、他人が決めるのです。Twitter にとっては、見かけほど無敵ではない Facebook に対して、大きく前進できる瞬間です。

ボットにチェックマークを?

これまでのところ、Twitter は ロシア のボットに注目していました。でも、すべてのボットに印を付けるべきです。政治ボット、商業ボット、金融ボット、荒らしボット、遊びのボット、ヘルプボット、セックスボット、宗教ボット、善いボット、悪いボット、怒るボット、悲しいボット、科学ボット。私たちは、誰が私たちに話しかけているのか、そして私たちが誰に話しかけているのかを知る必要があります。どうやって?

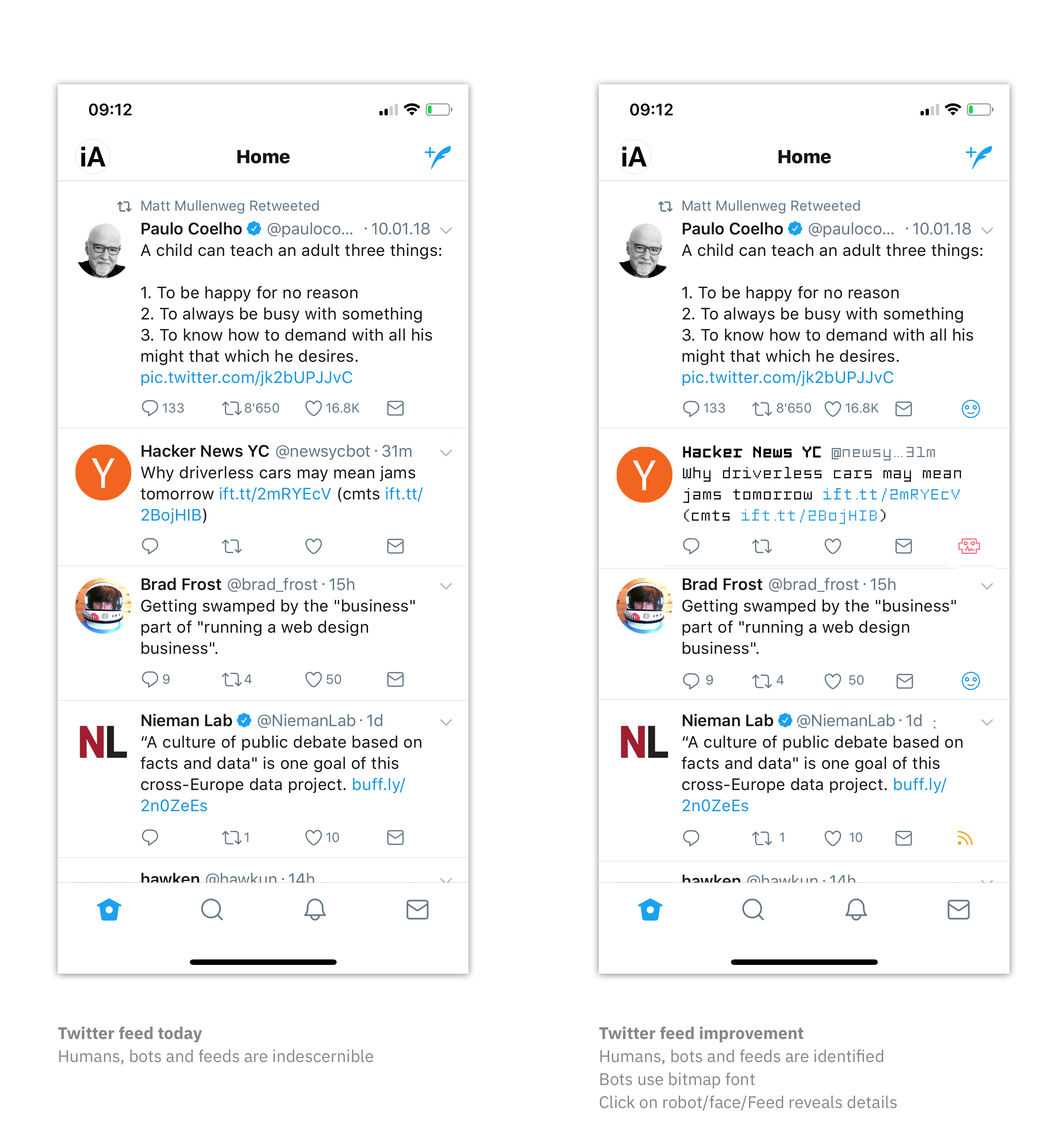

Twitter には、認証済みアカウントのチェックマークがあります。では、ボットにもチェックマークを付けてはどうでしょう? 難しいことではありません。今の Twitter では、人間、ボット、フィードが見た目上ほとんど同じです。ボットにチェックマークを付け、ロボットらしいタイポグラフィを与えれば、ずっと見分けやすくなります。機械的な書体とチェックマークがあれば、機械と人間は識別可能になります。

単純な Bot-or-Not の判定に加えて、Twitter は、なぜそれをボットだと見なし、なぜ人間だと見なすのか、その詳細を示すべきです。ボット、人間、フィードの自己申告を促すのです。

このスケッチを見れば分かるように、アカウントが人間であることを自動で検証するには、いくつもの識別要素が必要です。どんな自動化されたセキュリティでも だまされうる ことは承知しています。

スパムを高くつかせる

ここでの狙いは、だますことを不可能にすることではありません。だますコストを上げることです。チェックとバランスのないシステムでボット軍団を組むのは、経済的に魅力的です。安いからこそ起きるのです。

もし情報を入力する機械装置を作らなければならなくなれば、スパム 1 件あたりのコストは指数的に上がります。とても安い人件費と、いわゆるペルソナ・ソフトウェアを組み合わせても、まだ採算が合うかもしれません。ただし人為ミスの可能性は高まります。低賃金で情報操作に従事する人は、必ずミスをします。人間は情報漏えいの危険を高めますし、機械で動くボット軍団に比べれば、常にずっと高くつきます。

ボットへのルールを厳しくすれば、投稿コストが上がるだけではありません。捕まった時のコストも上がります。人間のふりをするボットは、アカウント停止や、そのアカウントを運営する人への制限・露出につながるべきです。だましは痛みを伴うべきです。スパマーが нервずくほど十分に危険で、ミスを誘うものでなければなりません。

ボットを見つける方法

「ボットを見分けられるようにする」という比較的単純な発想から、スパムを不可能にはしなくても、高くつくものにするための一連の仕組みを導けます。機械が私たちを真似る方法はたくさんありますが、ある時点で、私たちを真似る機械は、人間が不正するより高くつくようになります。スパムのコストを上げるための要件は、たとえば次のとおりです。

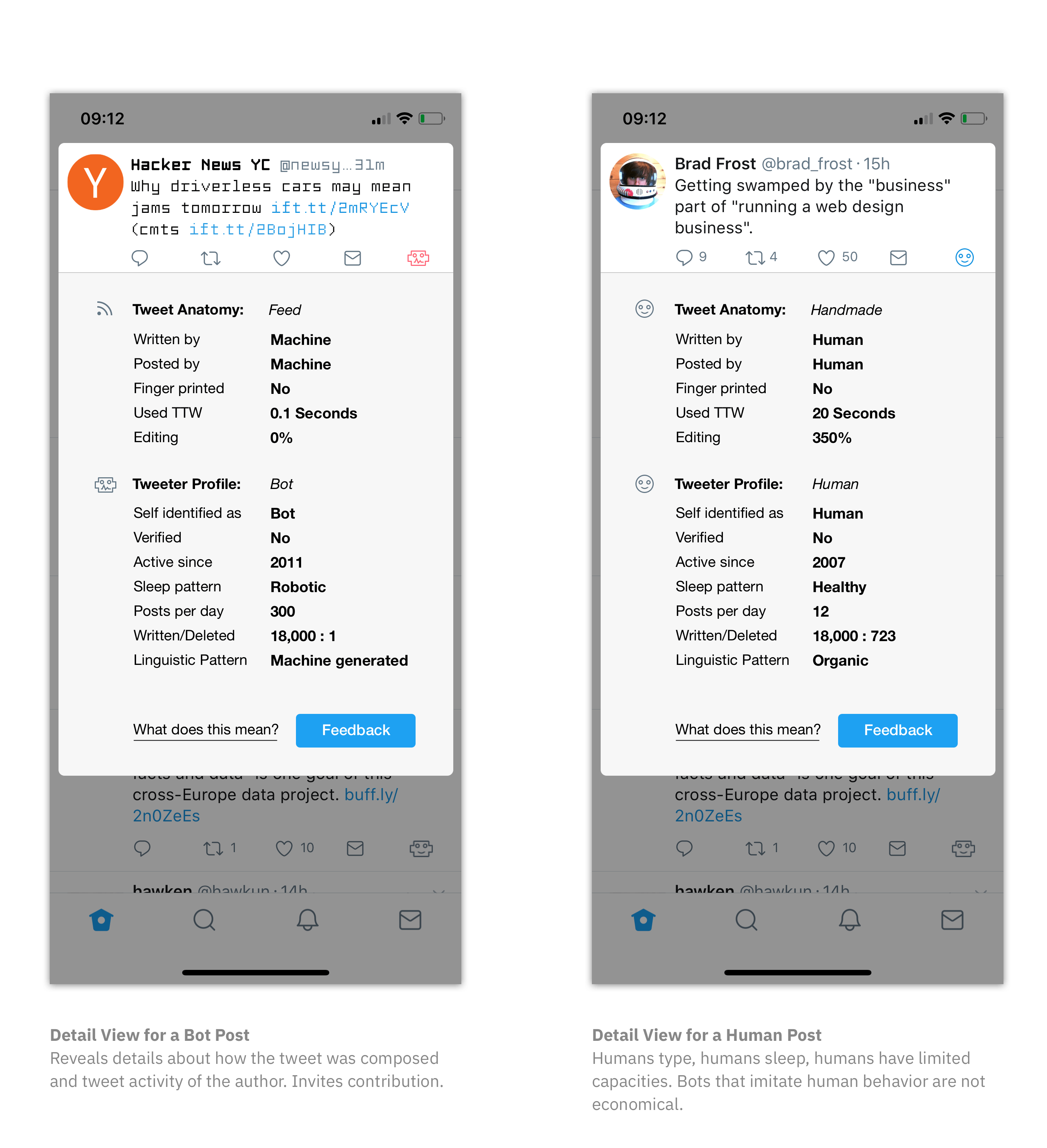

情報は手で入力されたことを求める: a) タッチ端末では、人のタッチかどうかを測る。b) メッセージを入力するのにどれだけ時間がかかったかを確認する。c) 完成までに必要だった修正回数を考慮する。d) 編集中の自然な動きを測る。きちんと設計すれば、システムをだますのに時間とインフラの面でかなり高いコストを課せます。

ツイートは手で投稿されたことを求める: ツイートが自動投稿か手動投稿かを確認する。指紋、顔、虹彩スキャンで真正性を証明できる仕組みを用意する。毎回スキャンする必要はありません。たまにで十分です。

人間らしい時間指標を確認する: 人間は眠ります。人間には、一定時間内に投稿できる量に物理的な限界があります。

人為的なミスを確認する: 人間は間違えますし、ツイートを削除します。ボットの中には、投稿→削除→投稿→削除を繰り返して人間らしく見せるものもあります。ツイート数と削除数の単純な比較でも、そのアカウントが人間寄りか機械寄りかの目安になります。

言語パターン: 人間が話すときには、独特の癖があります。言語は指紋のように個性的です。いまや言語処理はかなり高度です。現状は私たちをだますために使われることが多いですが、技術の悪用者に追加の障壁を課す用途にも使えます。

社会的コントロール: フィードバックボタンがあれば、ボットが自動検出の隙間をすり抜けた場合や、アカウントが誤って疑われた場合に、人が介入できます。フィードバックの流れは、通常の投稿よりさらに不正しにくくなるよう、巧妙に設計される必要があります。

技術的フィンガープリント: Twitter はあなたの IP、端末 ID、膨大な分析データを持っています。個人データを使って石けんやトースターを売っているのと同じ仕組みを、アカウントがボットかどうかの判定にも使えます。買い物をするユーザーは、ボットである可能性が低い。逆に、信頼されるために買い物をするなら、それはそれでいい。スパムの価格が上がるだけです。

この草稿は、10 年と 1 つの午後で作ったものです。すぐ実装できる対策もあれば、時間がかかるものもあります。Twitter への贈り物として書いた、手早い下書きです。改善の余地はまだたくさんあります。項目は網羅的ではありませんし、Twitter のデザインチームなら、きっと私たちよりずっと良い仕事をしてくれるでしょう。

結論

ロボットが私たちに奉仕し、私たちがロボットに支配されないようにするには、私たちがロボットと話しているのか、ロボットが私たちに話しているのかを見分けられなければなりません。人間とロボットを区別できないなら、アシモフの三原則は意味を持ちません。ロボットを識別できれば、SNS などにおけるスパムの主要な増幅器を一つ減らせます。

私たちのブログを Twitter のデザインチームが読んでいることは知っています。この投稿の意図を、Twitter のリーダーシップが汲み取ってくれることを願っています。さらに、アクティブユーザー数が大きく減るかもしれないと分かっていても、ボットに印を付ける勇気を持ってほしいのです。すべてのボットに印を付けたときに起こる地震のような変化は、Twitter だけでなく、すべての SNS に長期的な影響を与えると私たちは考えています。長い目で見れば、それは信頼の増加につながります。正しく実施できれば、多くのボットやフィードのアカウントが自己申告するようになるでしょう。

ボットは SNS だけの問題ではありませんし、SNS に関する唯一の問題でもありませんが、今日私たちが抱えている多くの問題を安く増幅する装置です。これを取り除ければ、私たちの心と生活、そして未来をかき乱そうとする詐欺師や犯罪者に大きな一撃を与えられます。

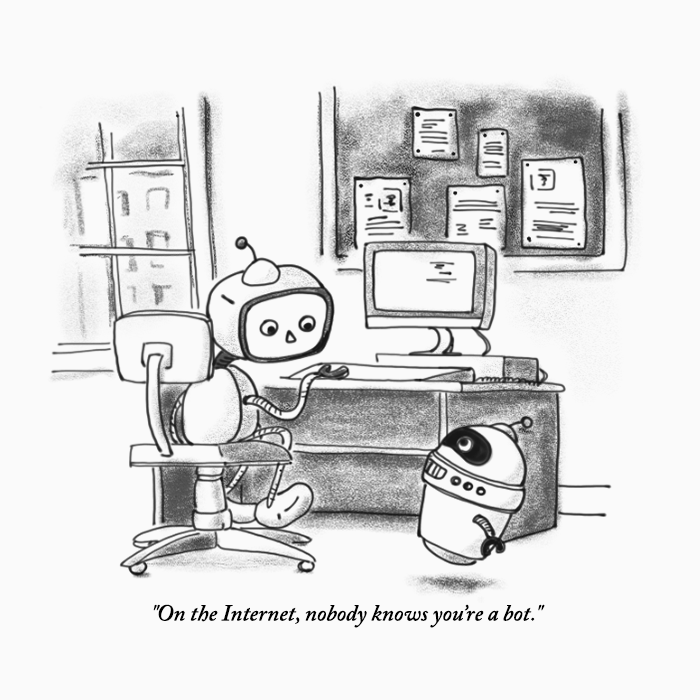

知らない方のために付け加えると、このイラストは Peter Steiner による、1993 年 7 月 5 日の The New Yorker の有名な風刺画をもとにした、私たちのオマージュです。