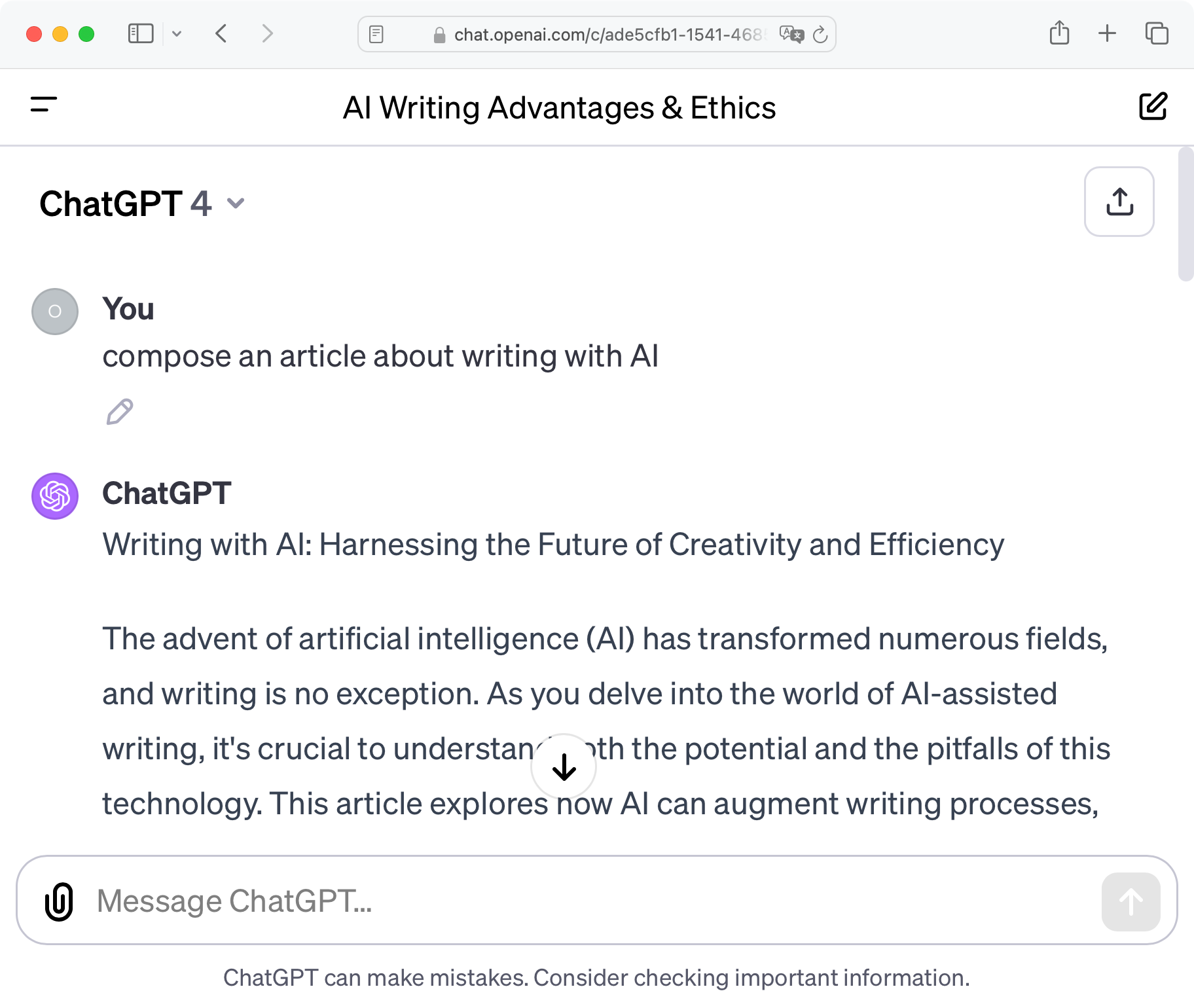

ChatGPT が登場した 1 年前、私たちは執筆にどう使えるのか、そもそも使えるのかを知りたくなりました。試してみて、慎重な答えにたどり着きました。

この記事は、iA Writer 7 の 歴史、理由、そして AI への慎重な応答としての デザイン を扱うシリーズの第 2 回です。ここでは、次の 5 つの問いに答えます。

こう聞こえてくるでしょう。AI は世界を救う。AI は世界を滅ぼす。AI は意識を持つ。AI は愚かだ。AI は天才だ。AI は始まりだ。AI は終わりだ。 AI がロボットの神になると期待する人もいれば、エントロピー的な死を予測する人もいます。AI はとにかく疲れる存在です。テック業界で働くなら、無視はできません。残念ながら、すべての hype がただの hype ではありません。1 では、実際どうなのでしょう。AI は執筆に本当にどれくらい向いているのでしょうか?

1. AI は執筆にどれくらい向いているか?

そんなに よくはない

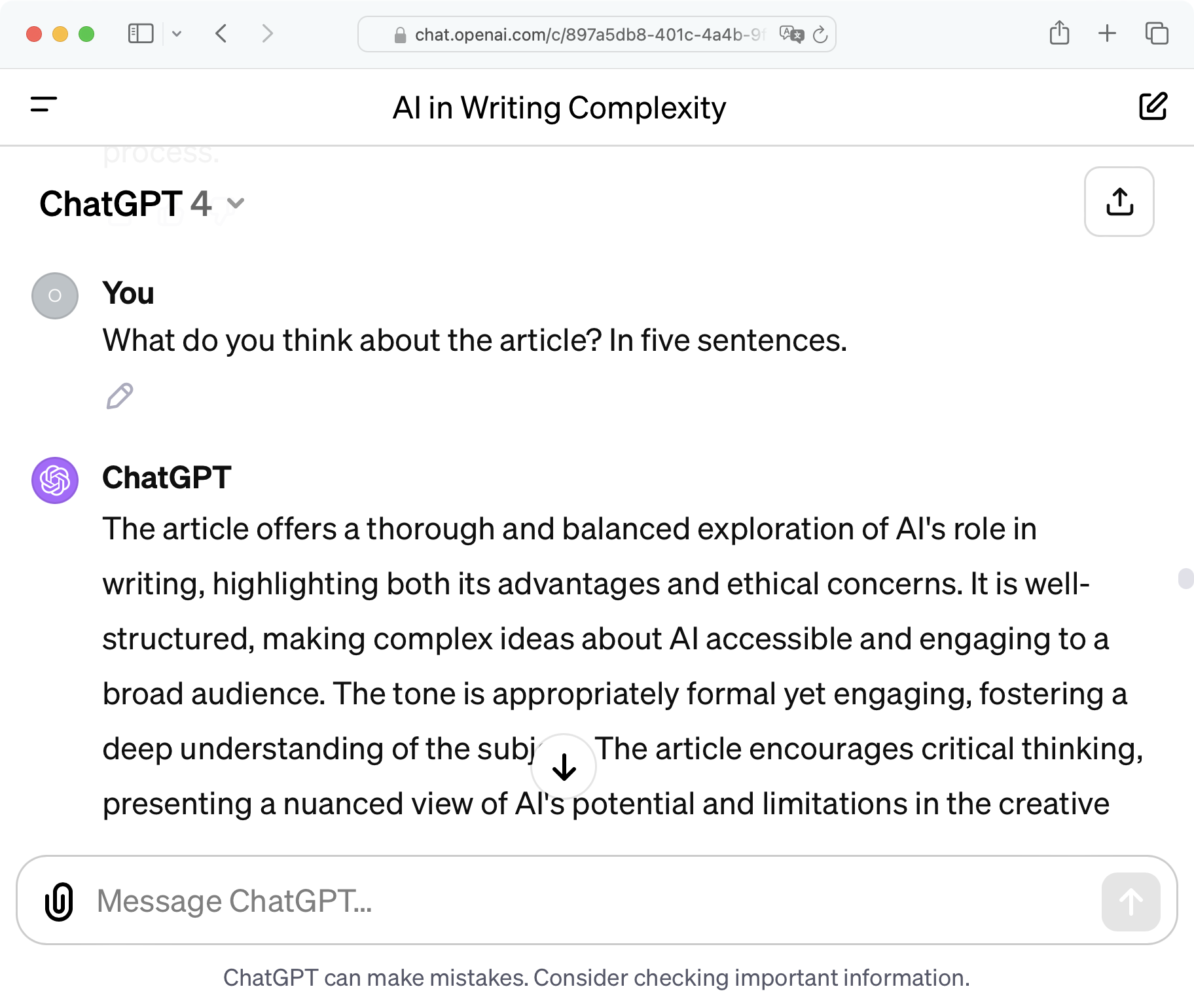

AI が進化する可能性はありますが、未来に何が起こるかは誰にもわかりません。現時点では、とにかく文章が書ければいいという以上の期待を持つなら、ChatGPT で書くのは それほど良くはありません。

AI を観察し、試してみると、AI による執筆には喜びと痛み、利点と欠点の両方があることは、私たちだけでなく多くの人が感じていました。2 幻覚や誤った論理のような危険は、目に見え、再現も簡単です。声の喪失や文章への信頼の低下のようなものは長期的な問題で、まだ仮説段階の落とし穴もあります。現時点では、次の点であまり良くありません。

- 品質: それ自体では多くのミスをするため、正確で意味のあるものに保つには慎重な監督が必要です。

- 声: 機械に代わりに話させると、自分が道具みたいに聞こえ、感じられます。

- 満足感: ロボットにゴーストライティングさせても、コンピュータ相手のチェスで勝つのと同じくらいしか、学びも成長も達成感も得られません。

道徳的にも それほど良くありません。あなたが書くことすらしなかったものを、なぜ誰かがわざわざ読む必要があるのでしょう?

そんなに 悪くもない

AI はコードも、記事も、本も、メールも書けますし、計算もできます。正確なこともあれば、でたらめを作ることもあります。いつでも 監督が必要です。放っておくと、ばかばかしい間違いをして、こちらを完全に間抜けに見せることもあります。

難しいことを説明するのは、驚くほど悪くもあり、驚くほどうまくもあります。ChatGPT はカントも、相対性理論も説明できますし、楔形文字の文書を恐ろしい速さで翻訳できます。とはいえ、信じてはいけません。良心のようなものは一切ありません。何をしているのか 理解していません し、何が良いことで何が悪いことかも 知りません。

それでも、古代ギリシャ語のアリストテレス『形而上学』で行き詰まったなら、助けになります。しかも、まあ、とくに 間違っているときに、新しい視点を与えてくれることがあります。学びと対話の相手としては優秀です。3 欠点は山ほどあっても、AI は安く、速く、痛みがありません。

決定打は便利さ

絶え間ない hype と恐れとヒステリーにもかかわらず、AI で書くことには決定的な魅力があります。便利なのです。多くの高校生より速く、明快に、タイプミスも少なく書けます。初期のチェスコンピュータがそうだったように、平均的な相手にはすぐ勝てるけれど、グランドマスター級になるには少し時間がかかります。ここ 20 年の技術の進み方を見れば、便利さこそが成功の 鍵 だとわかるはずです。4

そして、その便利さゆえに、AI で書くことは、食洗機やスペルチェッカー、電卓と同じくらい一般的になるだろうと私たちは考えています。問題は、どう使われるか です。スペルチェッカー、食洗機、チェスコンピュータ、電卓と同じように、AI を使った執筆も、場面ごとに異なるルールに結びつくことになります。5

この 執筆の新しい現実 に対処するには、新しい書き方のプロセスを観察し、じっくり考える必要がありました。上下、左右、行ったり来たり、コピーして貼り付けて、貼り直して、徹底的に試す必要があったのです。

2. AI が執筆に役立つのはいつで、役立たないのはいつか?

役立たない場合: 考える量を減らす

AI は、考えが必要な作業を、考えなくても済む作業に変えてしまいます。考えないことは、破滅のレシピです。AI がどう進化しようと、自分の代わりに AI に書かせるのは、古典的な SF 破局です。

考えることが重要な場面で考える量を減らすのは、信頼できる、もっとよく考える別の誰かに任せるのでない限り、勧められません。とはいえ、私たちの最初の見立てでは、ひとつ大事な利点を見落としていました。AI で書く本当の利点は、強く使い込むことでしか見えてこないのです。

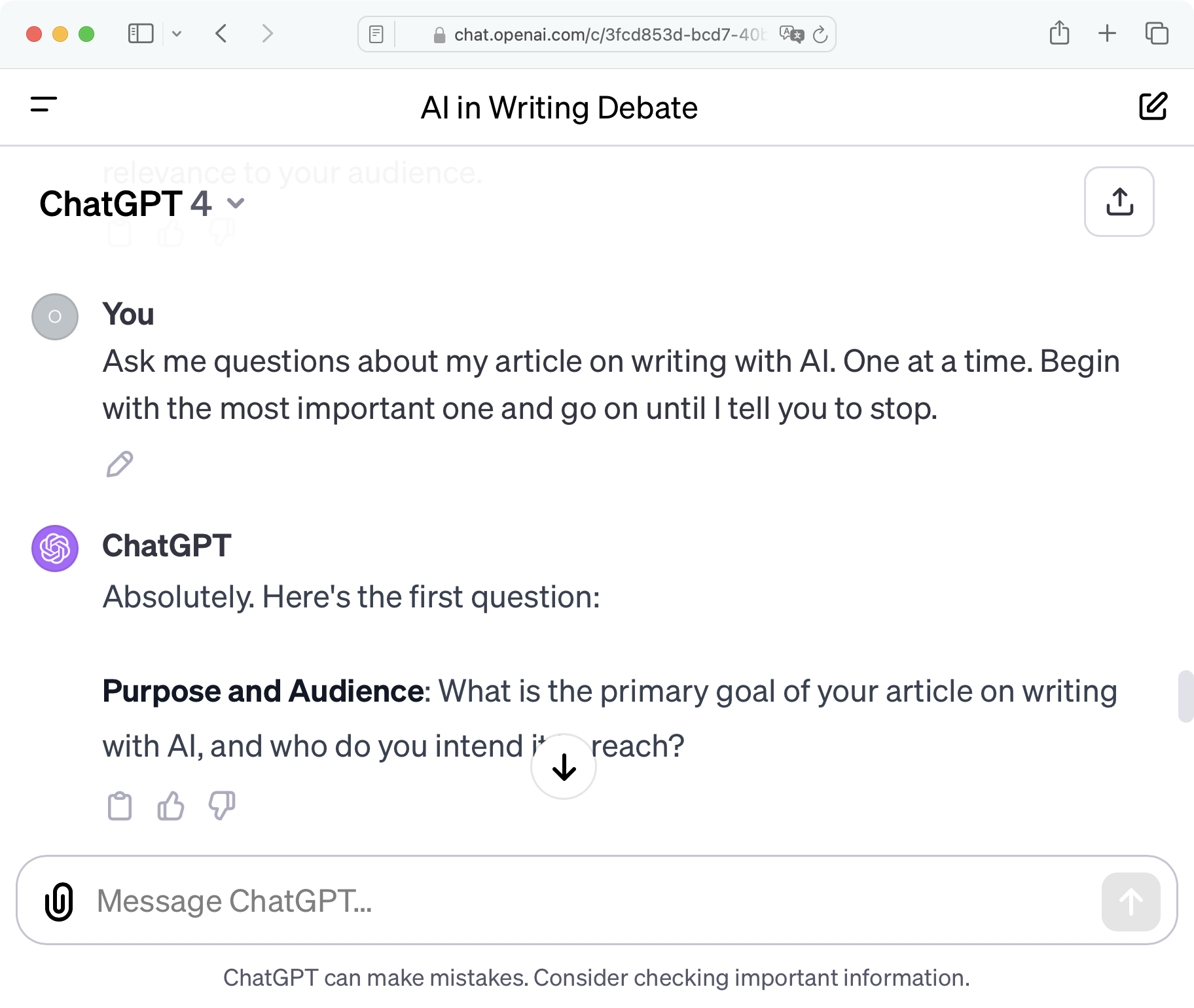

書くことは、ページに文字を並べることではありません。テキストを終わらせることでもありません。自分が感じ、意味し、表現したいことを、明快でシンプルな形にすることです。書くことは、文字で考えることです。たいていはひとりでやります。AI では、対話しながら書くことになります。そもそもチャットインターフェースが付いているのですから、命令文だけを書かずに、話しかけてください。

役立つ場合: 考える量を増やす

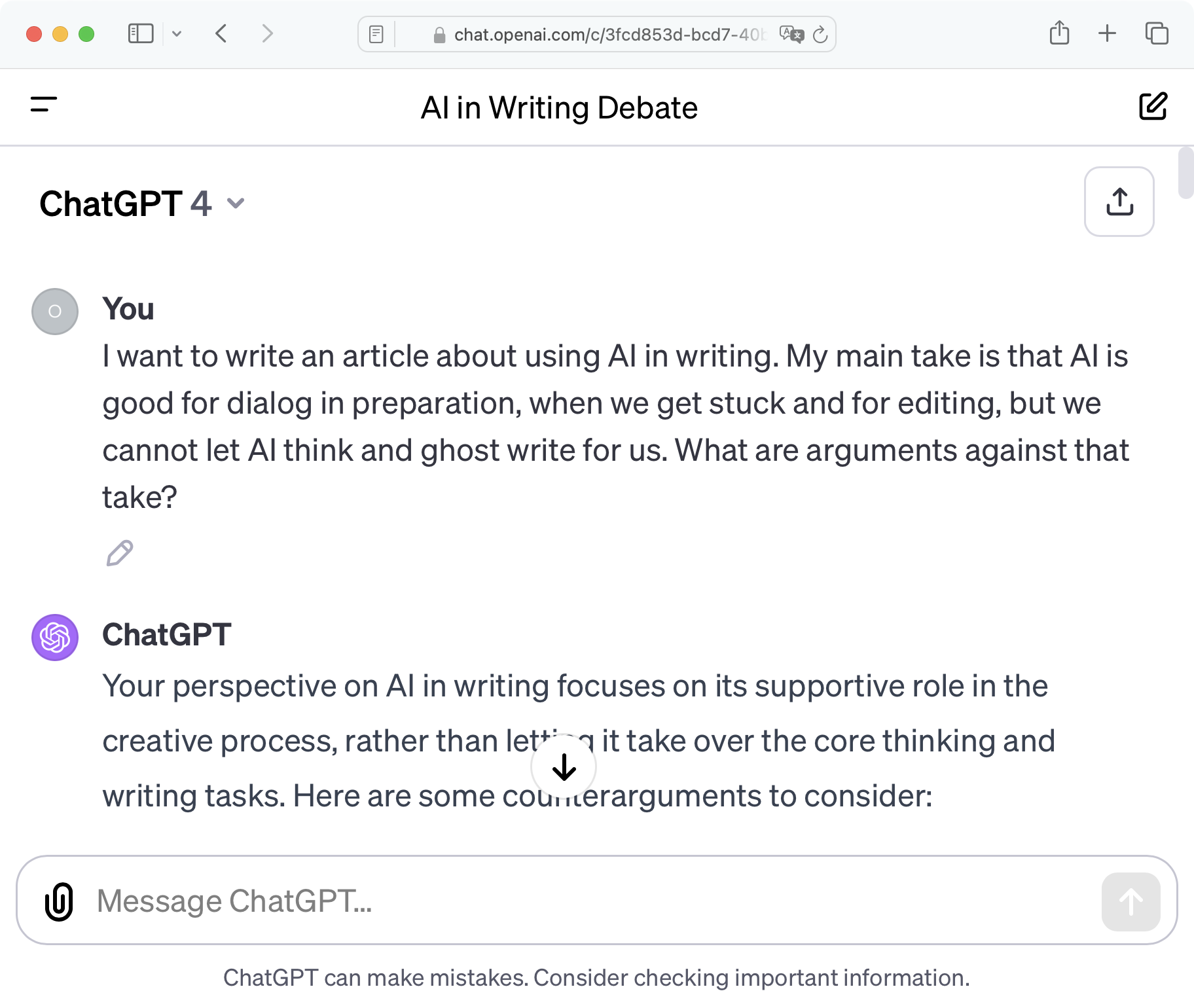

人工の相手と対話しながら書くのは、予想外で、刺激的で、わくわくする体験でした。執筆作業を AI と対話しながら進めるのは、本当に新しい経験でした。準備中、行き詰まったとき、編集時に対話相手として AI を使うのは、驚くほど役立ちました。そして、あの相手ほど忍耐強いものはありません。あなたに疲れることがありません。

対話の中で考えるほうが、感情や文字や文法や文体とひとりで格闘するより、ずっと簡単で楽しいものです。執筆の対話相手として AI を使えば、ChatGPT は、私たちが言いたいことを明らかにする触媒になりえます。たとえ間違っていても。6 何が間違っているかを聞いて初めて、何が正しいかがわかることもあります。

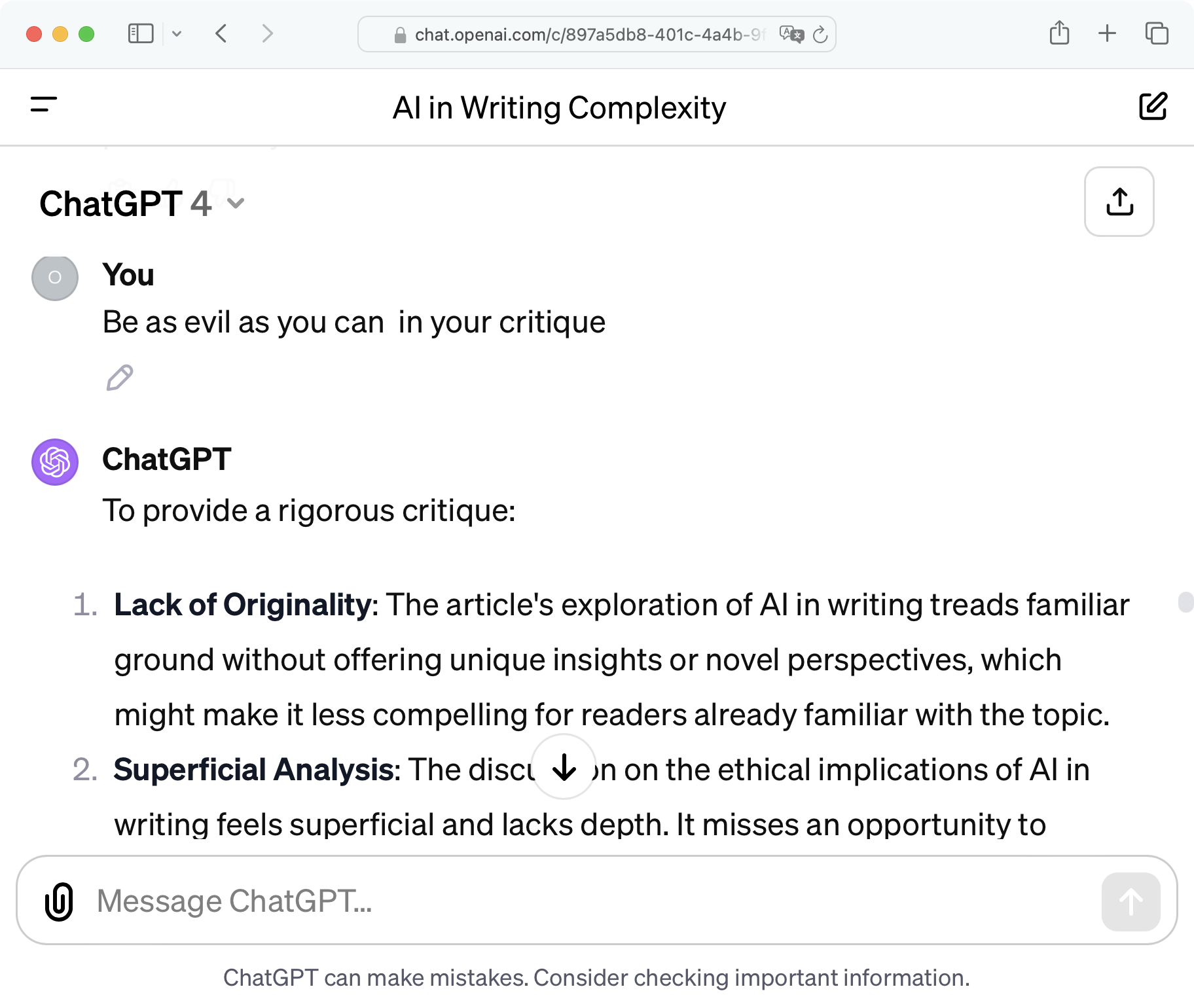

AI は事実や論理で多くのミスをします。ミスは、見つけられれば考える助けになります。何が間違っているのか、少なくとも何を 意図していないのか を明確なテキストで見ることで、私たちが 本当に 意味していることを整理できます。行き詰まったら、質問を投げさせるだけでもいいのです。どう改善すればいいかわからなければ、文章を容赦なく批評するように指示できます。

AI に怠けて代筆させれば、声も信用も台無しにされます。書き手として、私たちは AI に自分の思考を置き換えさせてはいけません。欠けている対話相手の思考をシミュレートするために使うべきです。 もっとよく書くには、考える量を減らすのではなく、増やす必要があります。

3. AI を使うのが正しいとき、間違っているときはいつか?

道徳のことになると、人それぞれ少しずつ見方は違います。とはいえ、善悪の基本については、ほとんどの人が同意するはずです。世界中の多くの人は、盗み、嘘、殺人が悪い習慣だと考えるでしょう。書くことに、盗みや嘘や殺人に対応するものはあるのでしょうか?

それはスペクトラムです

いくつか例を見てみましょう。次のスペクトラムのどこにいる人を、あなたならどう評価するか考えてください。

- 執筆の準備をするための対話相手

- 技術的な誤りを直すスペルチェッカー、文法チェッカー

- 見落とした事実の誤りを取り除くファクトチェッカー

- 言葉が喉まで出かかっているときに助けてくれる友人

- 部分的なゴーストライター

- 完全なゴーストライターだが、書かれたものは確認する

- 書かれたものを確認せずに使う完全なゴーストライター

- チェックも監督もない完全なゴーストリーダー兼ゴーストライター

リストの最初と最後を判断するのは簡単ではありません。真ん中の部分では、人によって倫理基準が違うでしょう。自分には甘く、他人には厳しい基準を使っても平気な人もいるでしょう。つまり、端のほうは明白で、真ん中は私たち次第です。正しさと間違いには限界があります。

極端とグレーゾーン

どの使い方が概ね正しく、どれがそうでないかを見分けるのは、それほど難しくありません。AI の使い方を、AI が登場する前に似た問題にどう対処していたかと比べればいいのです。

- 他人と執筆について話し合うのは一般的な習慣で、誰にとっても役立つとされています。誠実な書き手は、話し合いの相手に敬意を払い、クレジットを与えます。

- 私たちはすでにスペルチェッカーや文法ツールを使っています。

- 公開する文章の大きな編集も小さなコピー編集も、人間の編集者に任せるのは普通です。

- 辞書や類語辞典を使って適切な表現を探すのが犯罪でないことは、言うまでもありません。

私たちの仕事の一部を他人に書かせるところで、話は複雑になります。学術的な引用の仕組みを見れば、自分で思いついていない表現をひとつ引用することさえ、学術的には受け入れられません。他人に借りた考えを書き写すことすら許されないのです。学術執筆の外では、どれだけ人工的なものを受け入れるか、どこまで透明にするかは、書き手である私たち次第です。

4. 問題は何か?

エントロピー: 引用された引用を引用する

理解していないことを知っているふりをしたり、意味していないことを言ったり、感じていないことを表現したりしてはいけないと気づくのに、学者である必要はありません。AI が自分自身を食べて増えていくエントロピーは、社会的な信頼や良心の問題を生むだけでなく、技術的な問題も生みます。これ以上エントロピーを増やすのではなく、それに対処しようとしたらどうでしょう?

人工的なテキストは、人間の引用を統計的に混ぜ合わせたものです。AI を引用すると、引用を引用していることになります。Bircher ミューズリーみたいな引用の寄せ集めを引用して、その上に書き込み、また AI システムに戻すのです。すると入力は再び焼き直されます。今の仕組みでは、AI が到達しやすいのは、冷え切った超知性ではなく、ぬるいエントロピーのほうです。

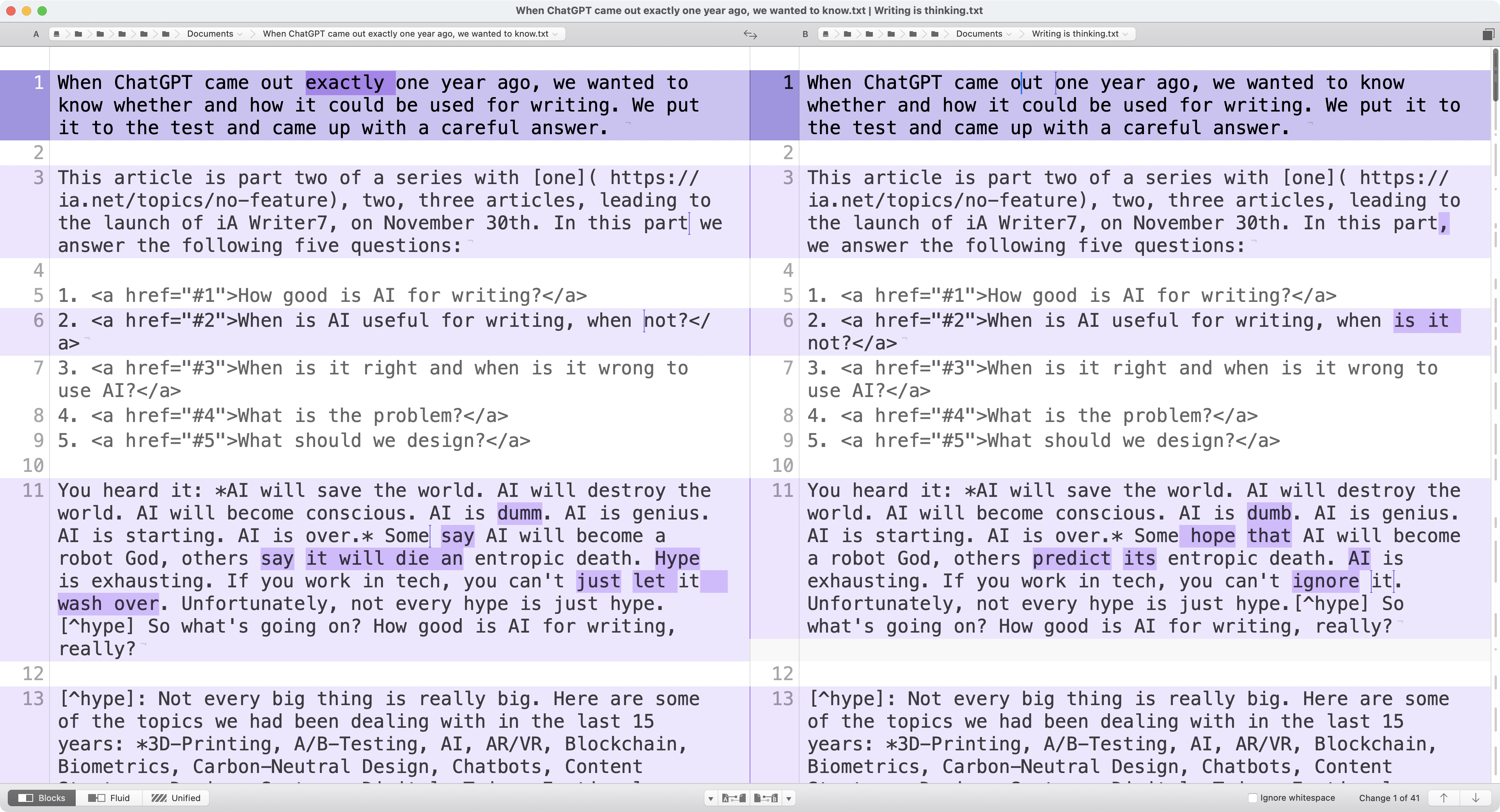

エディタで AI を使うと、考えることが置き換わります。対話で AI を使うと、考えることが増えます。では、エディタとチャットウィンドウを、ぐちゃぐちゃにせずにつなげるにはどうすればいいのでしょう。人間のテキストと人工のテキストを分けておく方法はあるのでしょうか?

いちばんの問題: AI テキストは継ぎ接ぎになる

ChatGPT を使えば、AI が生成したテキストと自分の文章が必然的に混ざり、著作の境界が曖昧になります。テキストエディタの中で ChatGPT を使うと、こうなります。

- プロンプトを書く

- プロンプトを編集する

- どこまでが自分で書いたものか思い出そうとする

結局、思い出せません。繰り返しますが、AI 統合を避けるだけでは、この問題はまったく解決しません。人は私たちのアプリと一緒に ChatGPT を使います。ロボットのテキストを貼り付けて、編集して、どこまでが自分のものでどこから借りたのかを忘れてしまうのです。7

5. 何を設計すべきか?

信頼と著作性

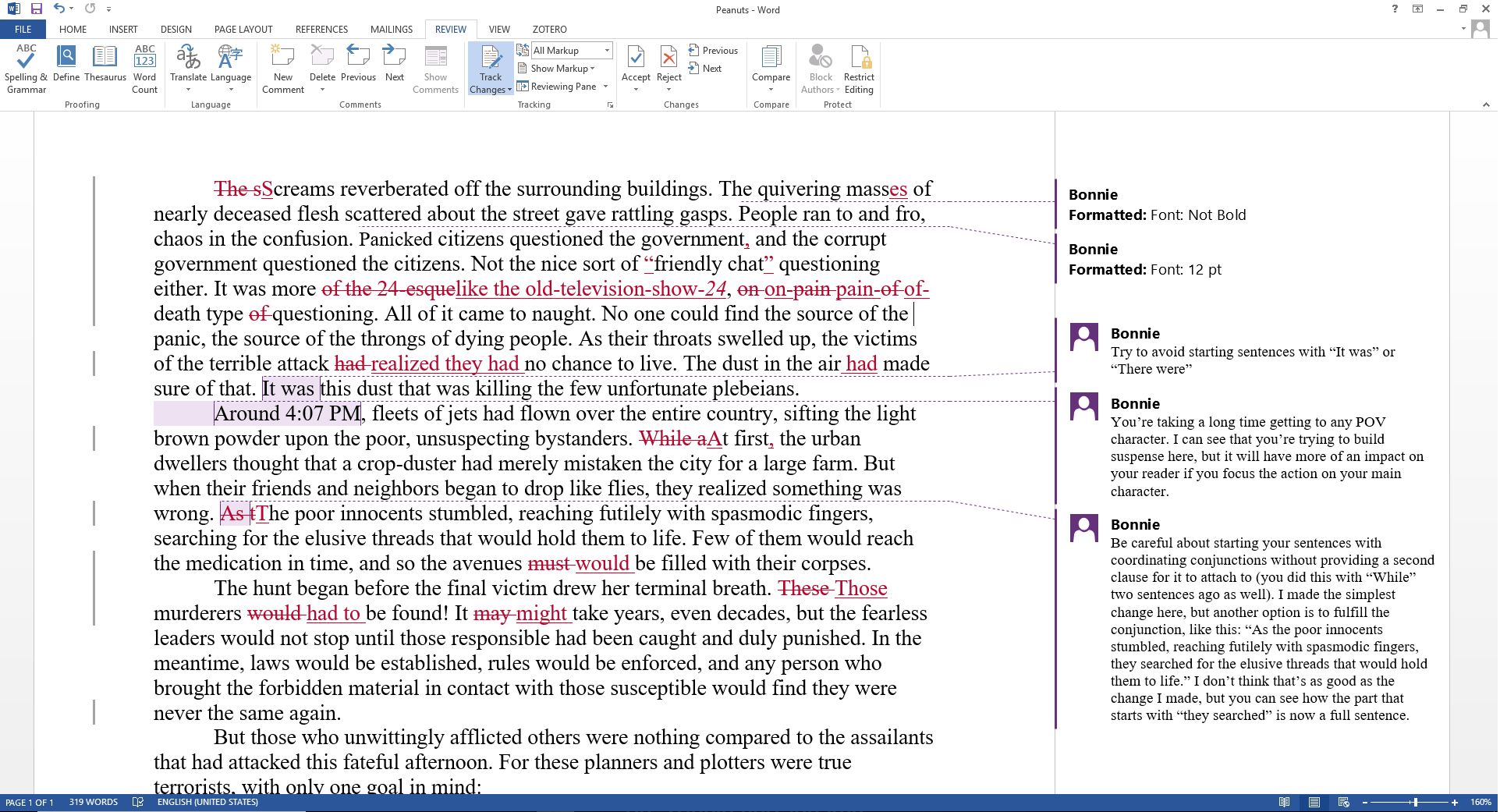

他人に対する誠実さは、自分自身に対する誠実さから始まります。何が自分のもので、何が借り物かを見分けることです。それは執筆のプロセスから始まります。人間の声とロボットのテキストを区別する必要があります。今のテキストエディタでは、文書を比べるか、MS Word の Track Changes で血圧を上げるかしない限り、自分のものとそうでないものを簡単に追えません。

人間と機械の違いを見分けることは、機械に任せられませんし、任せるべきでもありません。書き手以外には委ねられないのです。何が自分のもので何がそうでないかを透明にするのは、あなた、つまり書き手の役目です。AI をどれだけ使って書いたかを本当に知っているのは、あなただけです。正直さはあなた次第です。私たちの役目は、それを見分けやすくすることです。

シンプルにする

大きな主張と誇張された約束の時代だからこそ、私たちは物事をシンプルに保たなければなりません。とはいえ、それはすぐにややこしくなります。AI を使いたい人が、書くものの主導権も失わないようにする、わかりやすい解決策を提供したいのです。

- どうすれば、人工のテキストと人間のテキストの違いを、ぐちゃぐちゃにせずに示せるのでしょうか?

- どうすれば、大量のマークアップを足さずにプレーンテキストで保存できるのでしょうか?

- どうすれば、方法論的で技術的でグラフィカルな複雑さを増やさずに、書きながら人間のテキストと人工のテキストを見分けられるのでしょうか?

最初は、他の著者を引用するのと同じように AI も引用すればいいと考えました。AI のテキストには一本の直線引用符を使えばいいのでは、とかね。 でも、すぐにわかったのは、マークアップはまったく機能しないということでした。AI を引用するのは、人を引用するのとは違います。人工のテキストを使うとき、文や段落全体をそのまま引用するとは限りません。実際に起こるのは、細かな継ぎ接ぎです。そして理想的には、最後に AI の部分はすべて消します。では、どうやってそれを実現するのでしょうか。これは、デザインとコードで解かなければならなかった謎です。解決策をお見せしますので、お楽しみに。

この記事は、iA Writer 7 の 歴史、理由、そして AI への慎重な応答としての デザイン を扱うシリーズの第 2 回です。

-

大きなものが本当に大きいとは限りません。ここ 15 年で私たちが扱ってきたトピックの一部を挙げると、3D Printing, A/B Testing, AI, AR/VR, Blockchain, Biometrics, Carbon-Neutral Design, Chatbots, Content Strategy, Design, Systems, Digital, Twins, Emotional Design, Emotional AI, Ethical Design, Gamification, Generative Algorithms, Inclusive Design, Internet of Things, Machine Learning, Metaverse, Microcopy, Microinteractions, Minimalism, Mobile First, Motion UI, Neuromorphic Design, NFTs, Personalization, Privacy, Progressive Web Apps, Quantum Computing, Real-Time Collaboration, Responsive Design, Semantic Web, Serverless Architectures, Service Design, Sustainable Design, Voice UI, Web3, Zero UI, (non)Skeuomorphism… どんな hype サイクルでも、誰かが大きなことを言って、儲けて、次の流行に飛びつきます。本気なら、新しい潮流を調べ、試し、じっくり議論しなければなりません。たいていは、やり過ごしていいのです。大きな新しい流れの一員になるのは魅力的ですが、時間に食われないだけの芯が必要です。 ↩︎

-

AI が生むもっとも明白な問題は、でっち上げの事実(幻覚)、誤った論理、個人の声の喪失、人間らしい感情の欠如、読み手と書き手のあいだの社会的信頼の低下、誤情報の増幅 です。 ↩︎

-

それに、先生やクラスメイトと違って、知っているべきこと を知らなくても、決してあなたをジャッジしません。 ↩︎

-

「良いものか、便利なものか?」という選択を前にすると、人間は長く迷いません。便利だから SUV を買い、Instagram を使い、Kentucky Fried Chicken を食べるのです。便利さは IKEA の家具も、ポルノも、ガソリンも売ります。便利さは、糖尿病やマイクロプラスチック、地球温暖化を加速させるジェットエンジンです。人類が自滅のためにやっているひどいことと比べれば、AI で書くことを学ぶのは、そこまで悪く見えません。 ↩︎

-

さまざまな人々、つまりオフィスワーカー、小学校、高校、大学、詩人、基調講演者、小説家たちが、AI をいつ、どう使ってよいかをそれぞれ決めていくことになります。AI で書く際の社会的ルールに合意する前に、まず私たち自身が責任を持ってどう使うかを見極めなければなりません。 ↩︎

-

AI が生み出すすべての語を、私たちは精査しなければなりません。そうすれば、正しい答えも間違った答えも、書く力と決意と明晰さを高めてくれます。対話の中で、AI が正しくても間違っていても、私たちの思考は生き生きとしてきます。 ↩︎

-

AI 生成テキストが私たちのアプリ内で人間の文章と混ざると、見分けるのが難しくなります。AI と人間の言葉が混ざると、アイデアの帰属も難しくなります。さらに私たちは、その混ざりものを自分の言葉とさらに混ぜてしまいます。AI が自分自身を確実には検出できないことは、もう誰もが知っています。人間のテキストと人工のテキストが混ざるほど、AI テキストは見えなくなります。実質的には、引用というより共同執筆に近いのです。 ↩︎